Mój artykuł wFORBESz dnia 12 września 2018 roku.

Takie pojęcia, jak algorytm czy robotyzacja często budzą skrajne, wręcz nieracjonalne reakcje. Fascynacji towarzyszy często niemal dziecięcy lęk. Nie dziwi mnie to. Doświadczamy globalnego cywilizacyjno – kulturowego przełomu, więc nawet przesadzona, emocjonalna troska o teraźniejszość, a tym bardziej o przyszłość, wydaje się usprawiedliwiona. Co ciekawe, nowoczesna technologia – budząc spory i kontrowersje – każe nam myśleć o podstawowych wartościach takich, jak dobro i zło.

Bezpieczniejsze od ludzi

Wyrazistym przykładem tego, jak rozwój technologii może polaryzować nasze poglądy są autonomiczne samochody. Osobiście uważam, że dają szansę na poprawę standardów bezpieczeństwa na drogach. I nie dziwią mnie opinie entuzjastów, którzy twierdzą, że za 15 lat nie będziemy mogli pojąć, że kiedyś samochodami kierowali ludzie.

Aby jednak sprawy poszły w dobrym kierunku, potrzebujemy uniwersalnych standardów wdrażania nowej technologii. Producenci autonomicznych pojazdów inwestując wielkie pieniądze, złożyli w pewnym sensie społeczeństwu obietnicę. Zgodnie z nią, powszechna akceptacja tych samochodów na drogach może zapobiec dziesiątkom tysięcy ofiar śmiertelnych w ruchu drogowym każdego roku (tylko w USA w wypadkach ginie 30 – 40 tys. osób rocznie).

Zwolennicy autonomicznych pojazdów często przytaczają wyniki wielokrotnie powtarzanych wyników badań, z których wynika, że za 90–95 proc. wypadków odpowiada kierowca, a nie technologia.

Samochody autonomiczne znów pod obstrzałem

W marcu, w amerykańskim mieście Tempe, pod kołami autonomicznego pojazdu zginęła przechodząca przez jezdnię kobieta. Nie zareagowały systemy bezpieczeństwa w samochodzie ani kierowca znajdujący się w środku. Wydarzenie wywołało mnóstwo komentarzy i pokazało z jak wielu perspektyw możemy na nie patrzeć.

Niektórzy, nieco złośliwie, nazwali wypadek wydarzeniem historycznym – oto bowiem sztuczna inteligencja ma na swoim koncie pierwszą ofiarę w ludziach. Opinie, że na publicznych drogach nie powinno się testować wadliwej technologii produkowanej przez prywatne firmy napędzane żądzą zysku, pojawiły się błyskawicznie. Sceptycy i krytycy formułowali tezy, że ludzie nigdy nie zaakceptują pojazdów autonomicznych. Powoływali się m.in. na badania przeprowadzone na zlecenie Reutersa/Ipsos jeszcze w styczniu. Jeszcze przed wypadkiem w Tempe, dwie trzecie Amerykanów nie miało zaufania do pojazdów autonomicznych.

Jak to wszystko poustawiać?

Przy okazji wspomnianego wypadku wyszły na jaw takie kwestie, jak przepracowanie kierowców testowych (zbyt wiele godzin spędzonych za kierownicą), rezygnacja z drugiej osoby w kabinie (wcześniej, przez długi czas, w testowej jeździe uczestniczyło zawsze dwóch kierowców kontrolujących pojazd). Ponadto firma testująca pojazd miała zdecydować się na strategię zwiększania komfortu jazdy (przez ograniczenie częstego, gwałtownego hamowania) kosztem zmniejszenia wrażliwości pojazdu na pojawiające się przeszkody. Ponadto, dziennikarze dotarli do wewnętrznych raportów, które wykazywały, że w trakcie testów pojazdy miały problemy z przejechaniem – bez ingerencji kierowcy lub bez hamowania – odległości jednego kilometra.

Nagrania z wypadku pokazują, że kierowca nie śledził z uwagą jezdni, zajmował się swoim telefonem. Mogłoby to być – paradoksalnie – potwierdzeniem tezy, że najbardziej niebezpieczni na drodze są ludzie za kierownicą. Ale byłoby to chyba uproszczeniem.

Powiązane artykuły:

– Kto zyska a kto straci na rewolucji cyfrowej?

– Kiedy przestaniemy być biologicznymi ludźmi?

– Sztuczna inteligencja to nowa elektryczność

– Tylko Bóg potrafi policzyć równie szybko, czyli świat komputerów kwantowych

– Machine Learning. Komputery nie są już niemowlętami

Piotr

Wątpię aby w Polsce dopuszczono sztuczną inteligencję do istnienia ponieważ jest doskonała a to nie idzie w parze z interesami większości środowisk u władzy nie tylko politycznych uwikłanych w korupcje, przekręty i ogólne kłamstwo ale również środowisk religijnych. Sztuczna inteligencja będzie mówiła prawdę a ta, jak wiadomo od dawna jest przeinaczana a społeczeństwo wprowadzane w błąd. Więc póki co na terenie PL może zaistnieć zaledwie namiastka sztucznej inteligencji lub coś, co nie ma z nią nic wspólnego. To coś podobnego gdyby Chrystus pojawił się w PL. Od razu został by wtrącony do wiezienia lub ponownie ukrzyżowany.

CabbH

Nie mówimy o tym, co dzisiaj ale o tym, co będzie jutro. Mało masz wizji integracji różnych urządzeń że sobą? Internet rzeczy, prace z Cortaną, Siri czy Alexą a to wszystko tylko z dostępnych rzeczy. Już teraz boty działają w necie, zapoznaj się z tematem algorytmów fb lub googla. Oczywiście, na razie to tylko same algorytmy, ale organizmy kiedyś też były tylko jednokomórkowe… A ewolucja zero-jedynkowa nie trwa miliony lat… Pozdrawiam.

Norbert Biedrzycki

According to McKinsey Global Institute, Europe could see growth up to 20% on average by 2030, if it scales up efforts in digital and AI

Krzysztof Bikowski

AI jako OKURWATERMINATOR jest przynajmniej stulecie przed nami.

Source: Informatyka stopień I. Żaden z prowadzących profesorów (a.k.a. ludzi z 30-40 lat expa) nie boi się AI.

Adam T

Ważne tematy Pan tu porusza. Gratuluję i troche zazdroszczę szerokich horyzontów

Andrzej44

Sądząc po tempie, w jakim rozwija się robotyka i badania nad sztuczną inteligencją możemy bez wielkiego ryzyka założyć, że już niebawem prawo i etyka będą musiały zmierzyć się z problemami, które w poprzednim wieku mogły wydawać się bardzo odległą przyszłością.

Jacek Krasko

According to Gartner:

„China and the US will be neck-and-neck for dominance of the global market by 2025. China which will account for 21 % of global AI power, ahead of the US on 20%. However, the US wins in terms of AI revenue (22 % vs 19 %). The third largest market is predicted to be Japan with 7 %”

As regards the number of Industrial AI market:

A new report from GSMA Intelligence forecasts that China is poised to lead the global Industrial AI market and could have as many as 4.1bn of the 13.8bn global AI Reve estimated to exist by 2025.

Norbert Biedrzycki

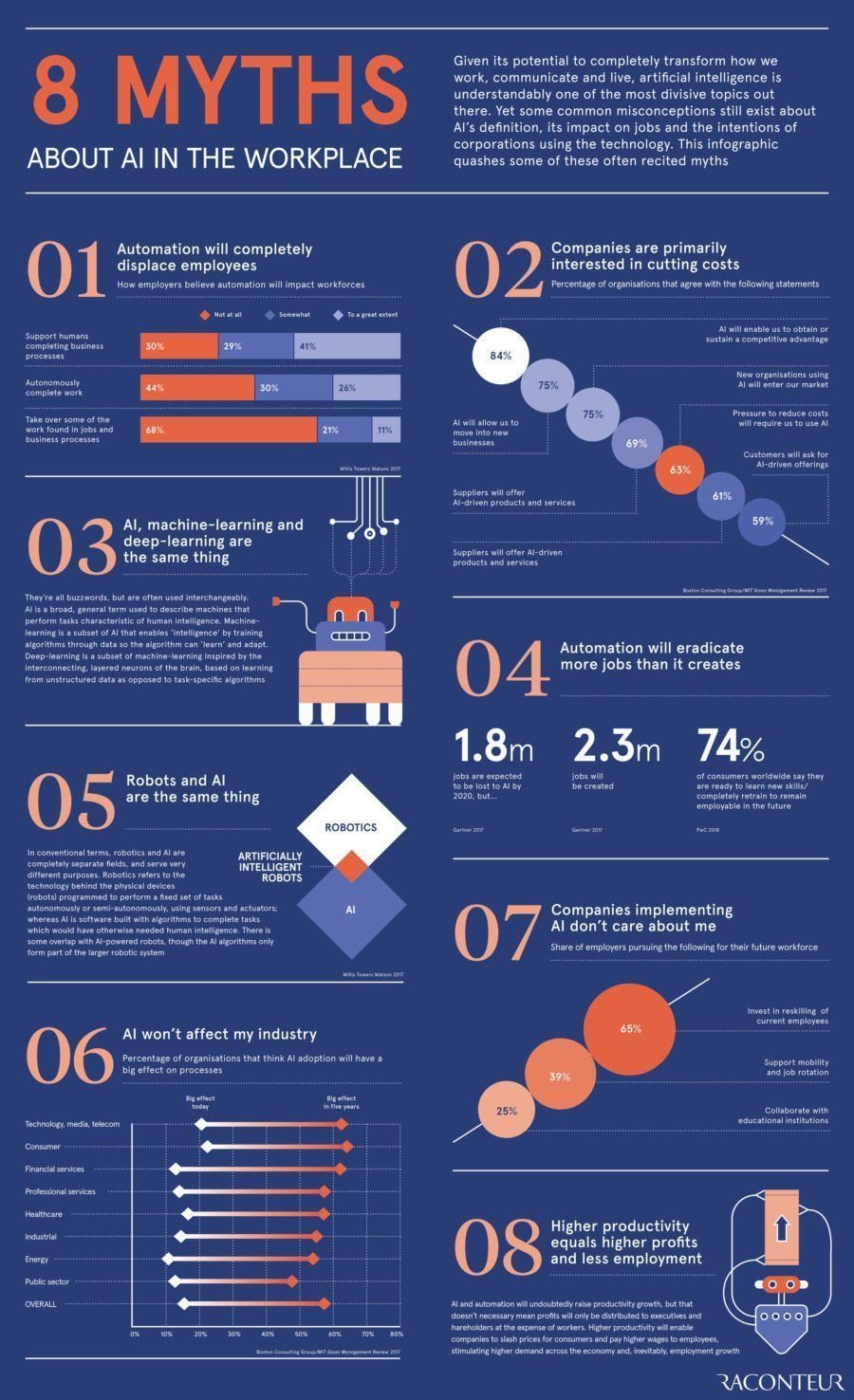

Mity AI @Raconteur

Zwierzak

Generalnie fajnie patrzeć na raporty oceniające różne technologie. Co z tego że rozwój tego rynku jest obiecujący ??? Obecnie mamy wyzwania globalne. Np. Zmiany klimatu i ograniczenia zużycia surowców i energii oraz zmniejszenie emisji co2. Jestem za podejściem gdzie dowolna technologia zweryfikowana jest w modelu, który wskaże jak generuje korzyści biznesowe i klimatyczne … A nie tylko biznesowe. Nadto produkcja dowolnych urządzeń zużywa nam zasoby i energię, których mamy coraz mniej 🙁 Więc paradoksalnie rozwój i potencjał każdej technologi stoi w sprzeczności z wieloma kontekstami w tym np. ryzyk dot. Climate Change.

Andrzej23

jakiegokolwiek hardware’u umożliwiającego transmisję danych

https://motherboard.vice.com/en_us/article/xygdwq/how-white-hat-hackers-stole-crypto-keys-from-an-offline-laptop-in-another-room

Tak tylko, tego, nie?

Andrzej23

ej ale ten „samochód” to za 200 lat będzie VGer. A po za tym Musk to kosmita który utknął na Ziemii i teraz tutaj napędza rozwój techniki bo chce wrócić do domu.

Andrzej23

Czy taka definicja będzie odpowiednia? Samodzielne podejmowanie decyzji adekwatnych do określonej sytuacji, w sposób niezależny i autonomiczny, na podstawie wcześniej zebranych i przetworzonych danych (przeżyć?) przez urządzenia/systemy/jednostki sterującej nie będące ludźmi a w stosunku do ludzi i nie ograniczonych blokadami logicznymi i/lub mechanicznymi.

JacekPlacek5

Mnie bardziej interesuje wszechświat i to co jest za jego granicą. Dlaczego był wielki wybuch i jeśli ta hipoteza jest prawdziwa to gdzie on wystąpił. Co to jest nicość, jak wyglada nieskończoność i co jest poza nią. 🤷♂️ Dzięki AI można uruchomić symulację świata (której tez możemy żyć) i jeśli tak jest to dalej pytanie o nicość i nieskończoność zostają bez odpowiedzi.

JacekPlacek5

Ależ tu nie o niszczenie ludzkości chodzi ale o problemy pojedynczych jednostek. Taki przykład: masz autonomiczny samochód. W garażu uległeś wypadkowi i w brzuch wbił Ci się kawałek blachy. Wsiadasz do takiego auta, ale nigdzie nie pojedziesz, bo Siri powie Ci że musisz najpierw zapiąć pasy lub że zanim zamknie drzwi najpierw umyj drzwi (które ubrudziłeś krwią)…

No dość znaczna, od rozpoznawania obrazów do zniszczenia świata jest daleka droga. Trzeba zacząć od tego żeby AI potrafiło samo się implementować i długo poczekać żeby coś z tego było. Zbyt długa droga od „napisz poprawnie kawałek kodu” do „zniszcz ludzkość”

MJarosz99

Bardzo dobry wpis

DCzaj

Ani roboty nie są niezależnymi istotami, ani algorytmy, które je ożywiają, ani sterowane algorytmami autonomiczne samochody. Nawet, jeśli dzięki machine learning i deep learning technologia może zwiększać własne możliwości i samodzielnie się uczyć na błędach, to ciągle największy wpływ na nią mamy my, ludzie.

AndrzejP34

A nie boi się Pan wszechogarniającej automatyzacji?

Norbert Biedrzycki

Musimy się dostosować jaki indywidualni ludzie i jako społeczeństwo. Postęp technologiczny

PiotrPawlow

Tu bardzo ciekawe rozszerzenie tematyki: https://miguelgfierro.com/blog/2018/10-ethical-issues-of-artificial-intelligence-and-robotics/

JacekPaczka

Następny fajny artykuł