Postęp dokonujący się od kilku lat w informatyce jest olbrzymi. Możliwości obliczeniowe tradycyjnych komputerów wydają się jednak ograniczone. Dlatego wszyscy, którym bliska jest idea nieograniczonego postępu technologicznego, kierują uwagę na urządzenie, które może spowodować kolejny przełom – komputer kwantowy.

O komputerach kwantowych mówi się od lat 80-tych, ale dopiero w ostatnich kilku latach stało się jasne, że ich rozwoju nie da się powstrzymać. Od tej pory zaczęły one budzić duże emocje. Specjaliści twierdzą wręcz, że jesteśmy coraz bliżej przekroczenia granicy, jeśli chodzi o szybkość procesów obliczeniowych.

Dlaczego? Współczesne procesory składają się z miliardów tranzystorów wielkości kilku nanometrów zgrupowanych na bardzo małej powierzchni. Według prawa Moore’a liczba tranzystorów w mikroprocesorze podwaja się co mniej więcej dwa lata. Niestety wzrost mocy obliczeniowych w procesorach ulega ciągłemu spowolnieniu. Powoli osiągamy bowiem granice technologiczne w możliwościach “upakowania” coraz większej liczby tranzystorów na tak małych powierzchniach. Granica, której fizycznie przekroczyć się nie da, to tranzystor o rozmiarze pojedynczego atomu oraz pojedynczy elektron służący do przełączania jego stanu od 0 do 1.

Być może ten rok będzie przełomowy, jeśli chodzi o rozwój tej technologii. Spory wpływ na formułowanie takiej tezy ma fakt dużego zaangażowania Microsoftu i Google w badania dotyczące takich urządzeń.

Również firma Atos, którą mam przyjemność reprezentować, zainwestowała w ostatnich miesiącach sporo energii w prace przybliżające nas do zbudowania ultra szybkiego komputera kwantowego.

Skąd biorą się wielkie zalety komputera kwantowego?

Najprościej można to wytłumaczyć, przez porównanie go do komputera tradycyjnego. Urządzenie, które znamy z codziennej pracy, dokonuje wszystkich operacji, wykorzystując podstawowe jednostki informatyczne, jakimi są bity. A te mogą reprezentować w zasadzie tylko dwa stany: 0 i 1.

W przypadku komputera kwantowego mówimy o wykorzystaniu stanu pośredniego, czyli wyjściu poza schemat dwóch przeciwnych wartości. Kubit (od bitów kwantowych) – bo tak się nazywa jednostka urządzeń kwantowych – może przyjmować jednocześnie wartość 0 i 1, a dokładnie może przyjmować nieskończoną liczbę stanów między 0 a 1. Taki stan nazywa się superpozycją. Dopiero podczas sprawdzenia wartości kubita, przyjmuje on jeden z dwóch stanów podstawowych – 0 lub 1.

Wydaje się, że to mała różnica, jednakże kubit znajdujący się w stanie superpozycji może podczas obliczeń wykonywać wiele poleceń jednocześnie. Pomagają nam tu podstawowe zasady fizyki kwantowej. Fizycznie kubit może być reprezentowany przez dowolny układ kwantowy o dwóch różnych stanach podstawowych, na przykład spinu elektronu lub atomu, dwóch poziomów energetycznych w atomie czy dwóch poziomów polaryzacji fotonu – pionową i poziomą.

O ile w klasycznym komputerze bit przechowuje dwie wartości, dwa bity przechowują cztery wartości itd, dwa kubity przechowują nie jedną, a cztery wartości jednocześnie a 16 kubitów może przechowywać 256 wartości naraz, czyli przy każdym kubicie jest dwa razy więcej możliwości. Bezpośrednią konsekwencją tego faktu jest to, że komputer kwantowy potrafi dokonywać jednocześnie wielu operacji na raz, czego nie potrafi urządzenie tradycyjne.

By jeszcze bardziej uściślić: kwantowy stan, o którym mowa, doprowadza nas do sytuacji, w której maszyna przetwarza potężne zbiory danych w niewyobrażalnie krótkim czasie. Wyobraźmy sobie tak pokaźne zbiory, że ich przetworzenie wymagałoby milionów lat, gdybyśmy wykorzystali do tego celu komputery tradycyjne.

Ta całkowicie abstrakcyjna sytuacja nabiera realności, gdy zaczynamy mówić o użyciu komputera kwantowego. Potrafi on liczyć nawet o setki tysięcy – a w założeniu miliony – razy szybciej od urządzeń zbudowanych w oparciu o zaawansowane podzespoły krzemowe! Idealne zastosowanie dla takiej maszyny to rozpoznawanie obiektów z ogromnego zasobu zdjęć, obliczenia na dużych liczbach, czy szyfrowanie i łamanie szyfrów. Operując na danych matematycznych, tę różnicę w wydajności między kwantowym a tradycyjnym komputerem możemy teoretycznie zwiększyć nawet do poziomu 1:18 000 000 000 000 000 000 razy!

Chłód i pełna izolacja

Jeśli chodzi o praktyczne wdrożenia z omawianej przez nas dziedziny, do dzisiaj największe zasługi ma kanadyjska firma D–Wave The Quantum Computing Company. Jej klientami są zarówno agencje rządowe czy NASA, jak i podmioty komercyjne, np, Google. To w tej firmie powstał pierwszy komputer, który otrzymał miano kwantowego – D–Wave.

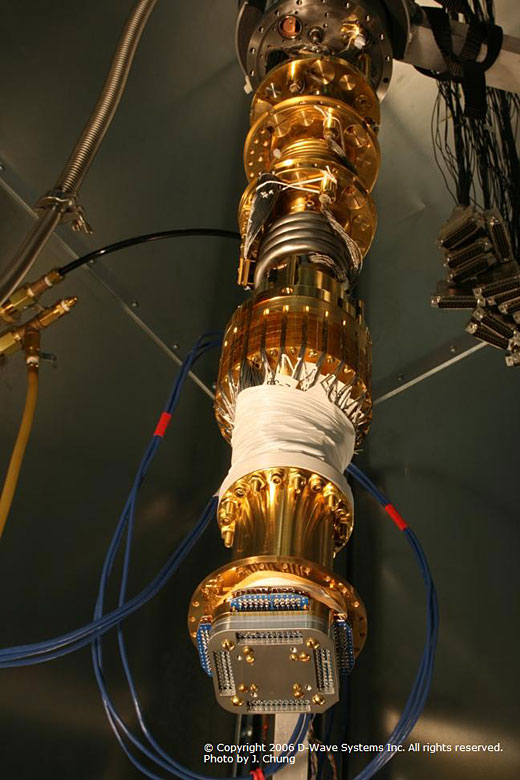

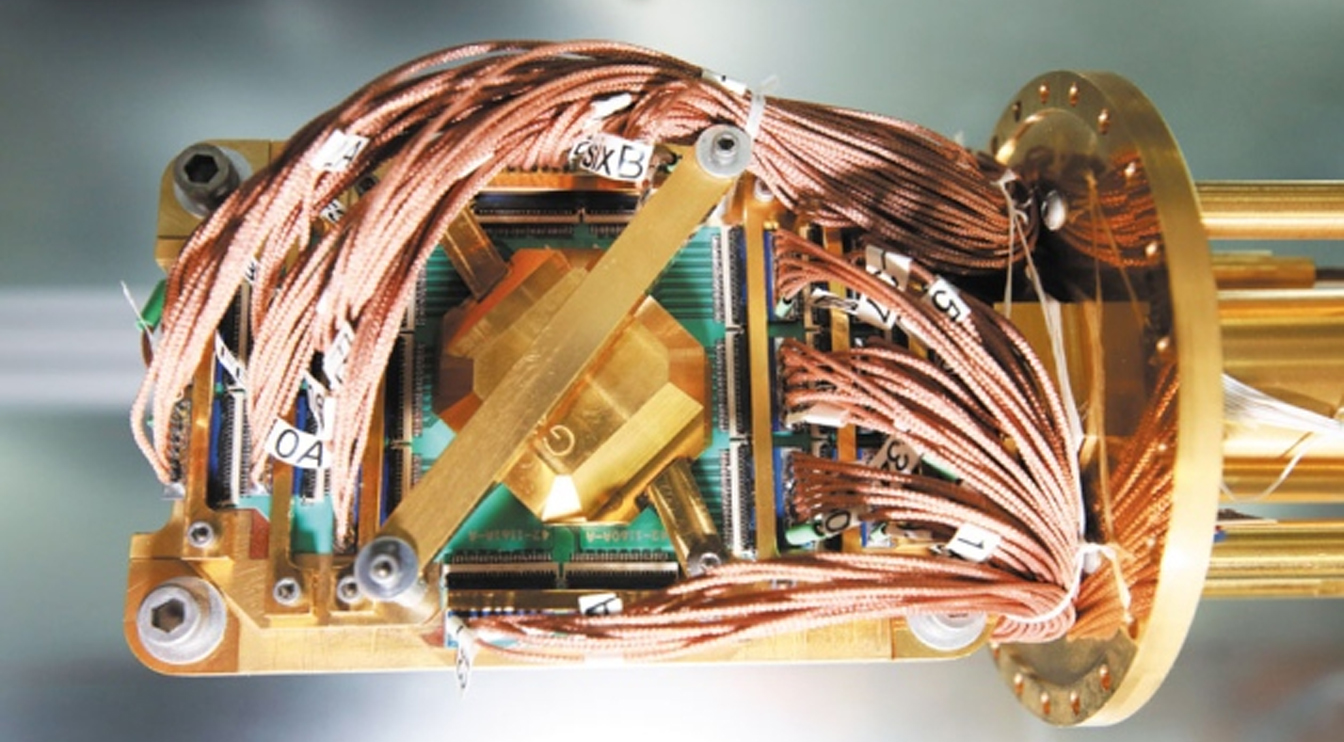

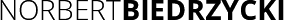

Dużo bardziej rozwiniętym urządzeniem jest produkt The D-Wave 2X™ System. Procesor komputera nie wytwarza ciepła, pracuje w środowisku o temperaturze 0,015 Kelvina (-273°C), która jest temperaturą 180 razy niższą od temperatury przestrzeni międzygwiezdnej. W środowisku procesora panuje próżnia, mamy bowiem do czynienia z ciśnieniem aż 10 miliardów razy niższym od ciśnienia w atmosferze!

Kubity muszą być całkowicie odizolowane od otoczenia, są bowiem bardzo nietrwałe i mogą być niszczone między innymi przez zmiany temperatury otoczenia, promieniowanie zewnętrzne, światło czy zderzenia z cząsteczkami powietrza. Dlatego próżnia, super niska temperatura i pełna izolacja środowiska są konieczne.

Chociaż już kilkakrotnie ogłaszano i dementowano informacje o pojawieniu się urządzenia, które spełniałoby warunki, by nazwać je komputerem kwantowym, The D-Wave 2X™ System przybliża nas do idei maszyny, dla której nie istnieje niemożliwe. Od razu zaprzęgnięto ten komputer nauczania maszynowego, systemów sztucznej inteligencji i do rozwiązywania problemów znanych z biologii, takich jak skręcanie białek. Jednak warto w tym miejscu wskazać też na głosy sceptyków i specjalistów, którzy od kilku lat z prawdziwą pasją poddają w wątpliwość fakty, które rozgrzewają dziennikarzy i ludzi biznesu.

A może to jest science fiction?

Aby przybliżyć z jak ciekawym, a jednocześnie kontrowersyjnym, zjawiskiem mamy do czynienia, przytoczę przykłady skrajnych reakcji przedstawicieli branży IT. Nie tak dawno jeden z przedstawicieli Google stwierdził, że kwantowy komputer D-Wave rozwiązał zadany mu problem w czasie 1 sekundy. Standardowy potrzebowałby na to podobno 10 000 lat! Z drugiej strony nierzadkie są opinie jak ta, którą wyraził fizyk Matthias Toyer. Gdy trzy lata temu ogłoszono, że komputer The D-Wave2 w specjalnym teście rozwiązał wyznaczone mu zadanie o 3600 razy szybciej, niż komputer tradycyjny, naukowiec zakwestionował te wyniki wykazując, że trudno mówić o takiej wydajności, bo żadne dowody jej nie potwierdzają. Najlepszym podsumowaniem zamieszania na tym polu, mogą być słowa pracownika Narodowego Instytutu Standardów i Technologii w USA, Davida Winelanda, który powiedział: „Jestem optymistą, co do tego, że w dłuższej perspektywie osiągniemy sukces. Jednak ten “dłuższy czas” oznacza, że nie wiem, kiedy to nastąpi”.

A może jednak rację mają przedstawiciele IBM, według których omawiane cuda techniki trafią do użytku nie wcześniej niż za kilkanaście lat, i będą to zdecydowanie urządzenia przeznaczone dla instytutów i laboratoriów, a nie dla przeciętnego użytkownika? Trudno mi dzisiaj jednoznacznie wyrokować.

I co możemy z tego mieć?

Do działania komputera kwantowego potrzeba systemu do sterowania, odpowiednika system operacyjnego, algorytmów pozwalających przeprowadzić kwantowe obliczenia i oprogramowania do obliczeń.

Tworzenie algorytmów kwantowych jest bardzo trudne, bo muszą one być opracowywane w oparciu o zasady mechaniki kwantowej. Algorytmy wykonywane przez komputer kwantowy są algorytmami działającymi w oparciu o zasadny prawdopodobieństwa. Oznacza to, że uruchamiając ten sam algorytm na komputerze kwantowym dwukrotnie, można otrzymać zupełnie różne wyniki ze względu na losowość samego procesu. Z tego wynika, że – upraszczając – dla uzyskania wiarygodnych wyników obliczenia należy uwzględniać zasady prawdopodobieństwa.

Brzmi to jak bardzo skomplikowany proces. I niestety tak jest. Komputery kwantowe nadają się do bardzo wyspecjalizowanych, określonych obliczeń – algorytmów, które pozwolą zaprzęgnąć całą ukrytą w nich moc. Czyli komputery kwantowe nie pojawią się na każdym biurku i w każdym domu. Nie miałoby to najmniejszego sensu.

Jednak bez względu na to, ile czasu potrzebujemy na uzyskanie danego wyniku pracy algorytmu, możemy już dzisiaj wyobrazić sobie sytuację, w której do rozwiązania konkretnego problemu angażujemy maszynę kwantową. Przykładowo, gdybyśmy założyli, że chcemy przetworzyć miliardy zmagazynowanych danych medycznych, które związane są z poszukiwaniem leku na raka, to właśnie komputer kwantowy, przy zastosowaniu odpowiednich algorytmów, mógłby zbliżyć nas do stworzenia skutecznej receptury. Bo możliwość interpretacji tych wszystkich danych bez popełnienia błędu, czy bez przeoczenia istotnych informacji, jest praktycznie niemożliwa dla ludzkiego mózgu, czy tradycyjnego komputera.

Technologie kwantowe mogą wpłynąć też mocno na takie obszary ludzkiej aktywności jak: astronomia, matematyka, czy fizyka. Komputery kwantowe mogą błyskawicznie przeszukiwać olbrzymie ilości danych – być może to jest główny powód dlaczego służby specjalne i Google tak inwestują w tą technologię. Komputery kwantowe mogą być idealnymi narzędziami do łamania szyfrów. Metodę RSA, chroniącą połączenia przeglądarek internetowych i połączenia w aplikacjach bankowości mobilnej i internetowej można by błyskawicznie złamać za ich pomocą. Ponoć jest to też pierwsza technologia, która zagrozi algorytmom kryptograficznym sieci blockchain i krypto walutom, jak bitcoin.

Jak widać technologia ma nie tylko blaski, ale i cienie. Czy możliwe będzie dalsze działanie zabezpieczeń szyfrujących, funkcjonujących do tej pory w naszym świecie? Czy będziemy w stanie zabezpieczyć się przed niebezpieczeństwem łamania najważniejszych dla nas szyfrów i kodów, których do tej pory pokonać się nie dało? Jak będzie wyglądał świat, w którym każda informacja będzie dostępna w mgnieniu oka? W mgnieniu oka, ale oczywiście nie dla wszystkich, tylko tych którzy będą wyposażeni w komputery kwantowe.

Powiązane artykuły:

– Niewidzialna pajęczyna wokół nas, czyli Internet Rzeczy

– Według naszych komputerów … Pan nie istnieje

– Upadek hierarchii, czyli kto właściwie rządzi w Twojej firmie

– Koniec życia jakie znamy, czyli witajcie w zdygitalizowanym świecie

– Twoi klienci przybywają z przyszłości, a ty gdzie jesteś?

– Blockchain ma potencjał do wzruszenia podstawowych filarów naszego społeczeństwa

– Praca przyszłości, czyli zaczniemy pracować od nowa

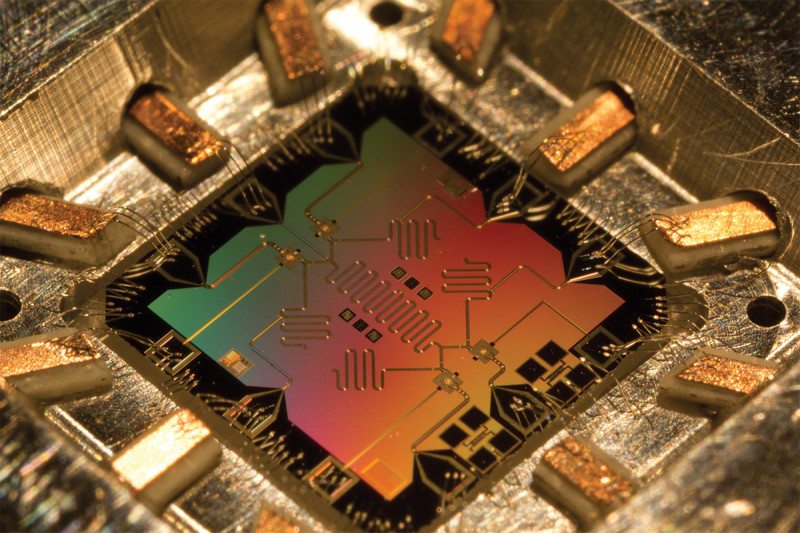

Obrazek 1: Komputer kwantowy. Kubit umieszczony w centrum procesora

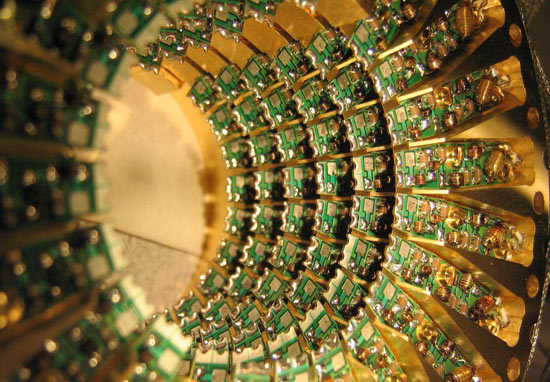

Obrazek 2: Komputer kwantowy. Cylindryczne rozmieszczenie płytek w tunelu komputera kwantowego

Obrazek 3: Komputer kwantowy. Obudowa układu umieszczona pomiędzy wymiennikami ciepła chłodzonymi ciekłym helem

Obrazek 4: Komputer kwantowy. Procesor zamontowany na końcu wieży z wymiennikami ciepła i urządzaniami do sterowania układem

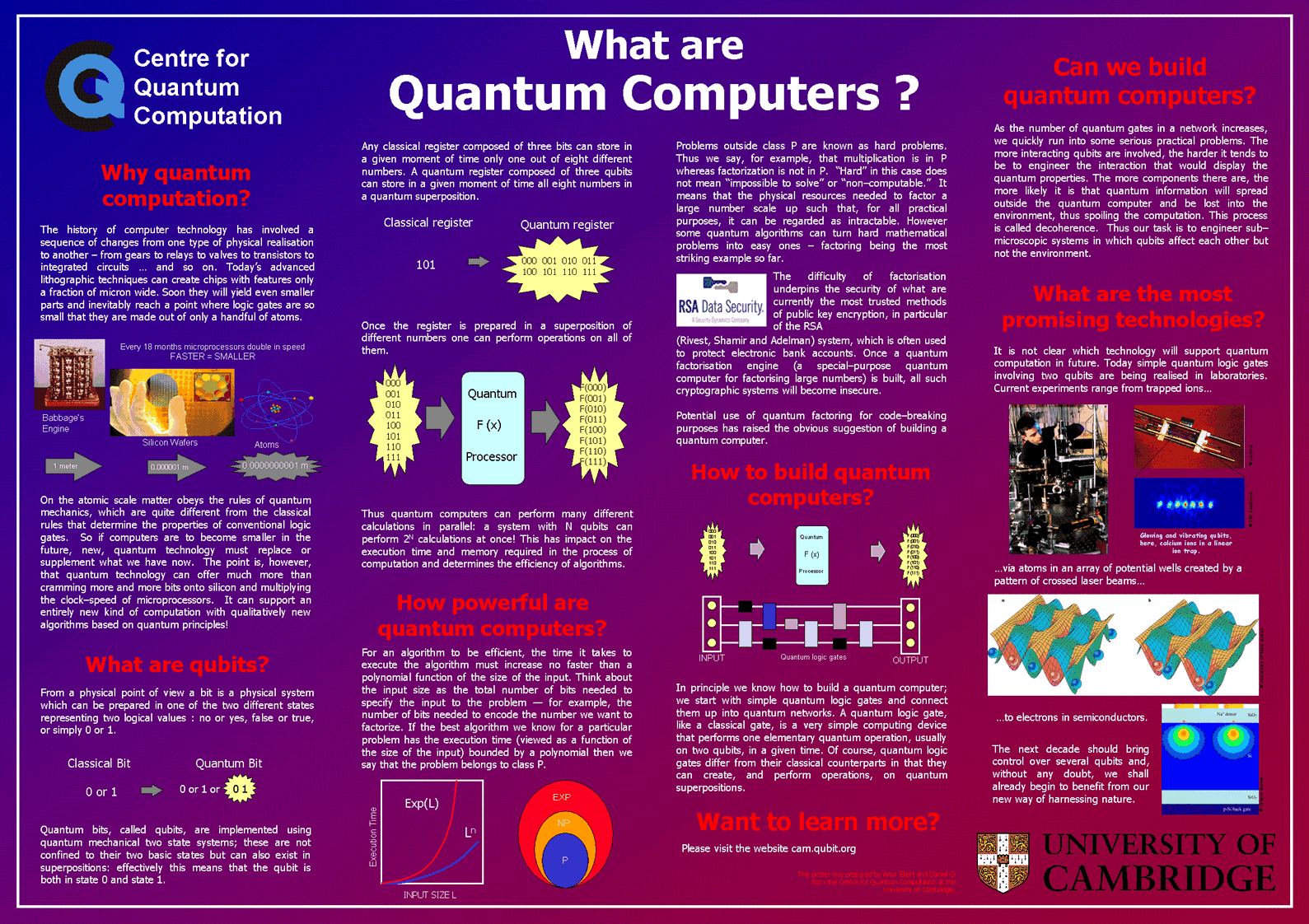

Obrazek 5: Komputer kwantowy. What are the quantum computers?; University of Cambridge

Andrzej44

Wynik obliczen komp kwantowych będzie tym bardziej dokładny, im więcej komputer wykona obliczeń. Innymi słowy, komputer kwantowy tak naprawdę określa prawdopodobieństwo, jaki jest wynik danej operacji, ale przy dużej liczbie powtórzeń jest to wystarczające, aby uznać go za prawdziwy. W wielu wypadkach znając już wynik, np. przy poszukiwaniu prywatnych kluczy RSA, można bardzo szybko zweryfikować kilka najbardziej prawdopodobnych rozwiązań i wybrać to właściwe. Czyli najwazniejsze jest efektywne zaprojektowanie algorytmow kwantowych – prawdopodobienstwa.

Piotr91AA

Chińczycy zainwestują do 2020 roku 10 miliardów dolarów w informatykę kwantową. To kilkakrotnie więcej, niż na tego typu działania wydaje cała Europa.

AndrzejP34

Dobry wpis

AKieszko

Co ciekawe w Polsce istnieją grupy z powodzeniem zajmujące się technologiami kwantowymi (Kubity spinowe np.). Na świecie w biznes kwantowy powoli wdrażają się IBM, Google, Microsoft więc może warto pomyśleć o prywatnych inwestycjach także w Polsce. Szczególnie, że kombinacja młodych naukowcow z potężnym biznesem IT mogłaby zwyczajnie zadziałać.

Czesław

Nie wiem po co nam komputery kwantowe skoro tylko 40% mieszkanców ziemi ma dostęp do interentu, łamanie szyfrów geometria symantyczna do tego wystarczy zwykly pecet. Dla mnie to mrżonka jak predkość nadświetlna która wg waszych probalistycznych obliczeń powina być wynaleziona do 2030 roku.

AndrzejP34

Łańcucha bloków jako księgi rachunkowej transakcji (przy obecnej mocy obliczeniowej komputerów) nie da się w żaden sposób podrobić. Najwięksi specjaliści od bezpieczeństwa szacują, że do złamania sieci blockchain wymagana jest moc obliczeniowa połowy współczesnego Internetu. Po wprowadzeniu komputerów kwantowych konieczne będzie jednak wdrożenie nowych zabezpieczeń kryptograficznych.

Norbert Biedrzycki

To jest odwieczny wyscig zbrojeń

Norbert Biedrzycki

Quantum computing use cases

CabbH

Ale jakie są zastosowania tych komputerów kwantowych? Oprócz mega szybkich obliczeń, łamania szyfrów i symulacji np zjawisk pogodowych?

JacekPaczka

Last week at IBM’s annual conference, Think 2018 (March 20-22, 2018), five interesting research projects were presented in featured sessions called “5 in 5”–“the technologies that will change the world in the next five years.”

Curiously, two of the five topics dealt with technologies that today stand at the brink of open conflict, with one of them at risk of annihilation. The two opposing forces are standard cryptography and quantum computing. The former represents a final line of defense against hackers, and the latter a developing computing capacity that will likely reduce conventional crypto to forgotten digital dust. If you try to imagine how that inevitability might alter today’s internet, you probably should begin with the elimination of both personal privacy and any safe commerce as a baseline.

http://sfmagazine.com/technotes/march-2018-quantum-computing-vs-conventional-cryptography/

Andrzej44

IBM sees quantum computing going mainstream within five years

IBM predicts five technologies that will change the world in the next five years.

From quantum computing to „unbiased” artificial intelligence, CNBC breaks down what the predictions will mean.

https://www.cnbc.com/2018/03/30/ibm-sees-quantum-computing-going-mainstream-within-five-years.html

PiotrDomski

Cytuję: „O ile w klasycznym komputerze bit przechowuje dwie wartości, dwa bity przechowują cztery wartości itd., dwa kubity przechowują nie jedną, a cztery wartości jednocześnie, zaś 16 kubitów może przechowywać 256 wartości – czyli przy każdym kubicie jest dwa razy więcej możliwości.”

To zdanie trzeba poprawić Panie Norbercie.

Bit przechowuje jedną z dwóch wartości, a dwa bity przechowują jedną z czterech wartości. 16 kubitów może przechowywać 65536 wartości jednocześnie, a nie 256.

Norbert Biedrzycki

Zgoda

Norbert Biedrzycki

Wewnątrz komutera kwantowego

Pingback: Norbert Biedrzycki: Czy roboty zaczną grzeszyć? | brandsit.pl

Jacek Krasko

Obecnie w pracach nad komputerami kwantowymi dominują dwie koncepcje. Jedna, wykorzystywana przez Google’a, IBM-a, Rigetti czy Quantum Circuits zakłada kodowanie stanów kwantowych w oscylującym prądzie elektrycznym krążącym w nadprzewodzących pętlach. Metoda druga, używana przez IonQ i wiele instytucji naukowych, to kodowanie kubitów w pojedynczych jonach utrzymywanych w próżniowych pułapkach przez pole elektryczne i magnetyczne.

Grzegorz Wiatr

Bardzo fajnie tłumaczy Pan skomplikowane zagadnienia. Bardzo dobrze czyta się Pana artykuły. Polecam Pana bloga moim znajomym.

Norbert Biedrzycki

Bardzo dziękuje. Pisanie bloga zmusza mnie do ciągłego rozwoju w tych kierunkach technologicznych które mnie interesują. Jest to fantastyczna stynulacja do nauki i rozwoju

Grzegorz Wiatr

Tytuł mocno prowokacyjny 🙂 Ale artykuł warty polecenia

Norbert Biedrzycki

Bardzo dziękuje. Nie było to zamierzone. Nie interesują mnie tematy kontrowersyjne

TomaszK1

Suoer zdjęcia. Artykuł godny polecenia. Prosto i czytelnie przedstawia dosyć trudne zagadnienie.

Andrzej K

Ciekawy artykuł. Nie wiem czy Pan zauważył ale system weryfikacji „czy nie jestem robotem” na Pana blogu działa dosyć koszmarnie. Nie pomaga w pisaniu komentarzy 🙂

Norbert Biedrzycki

Panie Andrzeju. Dziękuje za uwagi. Czy mógłby Pan wysłać maila z informacją co tak przeszkadza przy obecnym set-upie wtyczki anty-spamowej?

Andrzej44

Ciekawe co będzie nastepne i czy wizje pisarzy sci-fi czy futurologów się ziszczą? Świat zaczyna coraz mocniej przyśpieszać

Krzysztof C

Bardzo ciekawa przyszłośc nas czeka. Oznacza to że prawo Moora zostaje rozszerzenie na maszyny niekwarcowe

CabbH

Tak jak zostało to tutaj już napisane – są to komputery przeznaczone do bardzo wąsko wyspecjalizowanych zadań. Nie będzie to maszyna na biurko każdego z nas

JacekPaczka

Prace naukowe trwają – pełna zgoda. Ale kiedy powstanie taki system dostępny dla każdego? I czy każdemu będzie potrzebny? Raczej nie. To będą komputery do bardzo wyspecjalizowanych zadań. Algorytmy (tak jak czytałem) są bardzo skomplikowane i oparte na statystyce

Adam T

Tytuł mocno prowokacyjny 🙂 Ale artykuł ciekawy

Jacek Czyz

Bardzo ciekawy punkt widzenia. Przyśpieszamy przetwarzanie danych a nie pracujemy nad aspektem emocjonalnym. Tylko jak odwzorować emocje u maszyny?

Ania_Kielak

Już dawno statystycznie wykazano, że ludzki przeciętny neuron pamięta ok. 4 bitów informacji. Czyli natura sama znalazła optimum. Owszem, są neurony niezwykle złożone głównie w hipokampie, które pamiętają znacznie więcej ale te 4 bity są w każdym

Robert Kaczkowski

IBM już dawno wyprodukował drugą wersję chipa neuronowego, który pracuje podobnie jak neuron w organiźmie zwierzęcym. W tym całym wywodzie który skupia się wyłącznie na elektrycznej percepcji neuronu zabrakło jednego. A mianowicie prawdziwy neuron nie jest sumatorem wagowym, lecz układem całkującym. I to realizuje chip IBM. pierwszy lepszy artykuł na ten temat który znalazłem:

http://www.benchmark.pl/aktualnosci/IBM_pr…mozg-36521.html. Ale takich artykułów jest sporo

Jacek B2

System superpozycyjny może operować na wielkszej liczbie stanów niż 0, 1 i pomiędzy. Teoretycznie liczba jest niograniczona

Jacek B2

Ciekawostką jest, że te wszystkie projekty machine learning, artificial intelligence i teraz szybkość przetwarzania danych przez komputery kwantowe, zmierzają do zasymulowania centralnego ośrodka nerwowego lub mózgu. Problem w tym, że odwzorowuje się jedynie jego część elektryczną, przy kompletnym braku odwzorowania części chemicznej, tj. wszelkich neuroprzekaźników, w tym chormonów. Także murem nie do przebicia jest zrozumienie zjawiska samo świadomości. Tu nie chodzi tylko o szybkość przetwarzania informacji

Norbert Biedrzycki

Ostatnie wiadomości:

China has beaten the world at building the first ever quantum computing machine that is 24,000 times faster than its international counterparts.

Making the announcement at a press conference in the Shanghai Institute for Advanced Studies of University of Science and Technology, the scientists said that this quantum computing machine may dwarf the processing power of existing supercomputers.

Researchers also said that quantum computing could in some ways dwarf the processing power of today’s supercomputers.

http://indiatoday.intoday.in/story/worlds-first-quantum-computing-machine-build-in-china/1/944280.html

Grzegorz Wiatr

Ciekawie napisany artykuł. Szkoda że tylko jak wynika z tego co Pan napisał jeszcze daleka droga do komercjalizacji tej technologii. No i niestety ale z tego też wynika że komputery które używamy na co dzień niestety ale osiągnęły swój kres jeżeli chodzi o wzrost prędkości przetwarzania danych. To jest zła informacja

Norbert Biedrzycki

Dokładnie tak. To są bardzo wyspecjalizowane komputery. Nie na każde biurko

Andrzej_Ko

Nie zgodzę się z opinią o zastosowaniach odpowiednika systemu 3 cząstek do obliczeń matematycznych. W świecie obliczeniowym nie ma to sensu. Logika trójkowa to spora komplikacja. Jak komuś mało stanów w superpozcji można sięgnąć po logikę analogową – wiele systemów nie tylko binarny, np. czwórkowy, szesnastkowy … Trójkowy to tzw. nazywa logika rozmyta – wielostanowa na zasadzie 'chyba tak’, 'prawie na pewno nie’.

Co do materii – znowu błąd. Elektron, neutron i proton to są trzy zupełnie różne cząstki elementarne, które same w sobie mają pary, tj. anty elektron, anty neutron i anty proton. Jedynie teoria strun zakłada istnienie trójek ale to zupełnie inna część fizyki.

TomaszK1

Pełna zgoda – nie do każdych zastosowań. System 0 i 1 ma podstawowe ograniczenie. System siperpozycyjny (kwantowy) tzw 0 i 1 powinny mieć opowiednie stany + dodatkowy stan pomiędzy 0 i 1 albo większy lub mniejszy od 0 i 1 – oznaczony rachunkiem prawdopodobieństwa. Cała materia składa się 3 cząstek, elektron (jako zero), neutron (jako jeden) i proton (wszystkie stany pomiędzy).

Norbert Biedrzycki

Bardzo ciekawa koncepcja. Można powiedzieć że trzeci stan to właśnie superpozycja, nieoznacznie stanu QB. To właśnie jest przestrzeń na oznaczenie wg. mechaniki kwantowej za pomocą rachunku prawdopodobieństwa pozycji cząstki. Co defacto daje mam przybliżenie prawdopodobieństwa wyniku