Programiści zajmujący się tworzeniem algorytmów wykorzystywanych w autonomicznych samochodach powinni przygotować się na to, że ich praca może niedługo stać się przedmiotem gorącej debaty etycznej. Rosnąca popularność autonomicznych pojazdów zaprząta już głowy prawników i ustawodawców. A to dlatego, że komplikują się kwestie dobra i zła, związane z bezpieczeństwem na drodze. Samochody autonomiczne mogą być dla prawników sporym wyzwaniem.

Samochody autonomiczne cieszą się coraz lepszą prasą, a zainteresowanie nimi rośnie. Branża z uwagą przygląda się osiągnięciom Tesli i koncernu Google. Ten ostatni regularnie udostępnia raporty, z których wynika, że jego autonomiczne auta przebywają coraz większą liczbę kilometrów bez usterki i bez stworzenia sytuacji niebezpiecznych dla ruchu. Wyczuwalny jest zwiększający się optymizm całej branży motoryzacyjnej, jeśli chodzi o przyszłość tego typu aut. Ich masową produkcję uruchamiają lub uruchomią wkrótce: Mercedes, Ford, Citroen, Volvo.

Prawie każdy liczący się producent potrafi więc dzisiaj zbudować autonomiczny pojazd, przetestować go i przygotować do ruchu. Ale to tylko początek. Jeszcze jakiś czas popyt na auta i przychody koncernów z tytułu ich sprzedaży będą ograniczone ze względu na skomplikowane kwestie prawne i… etyczne.

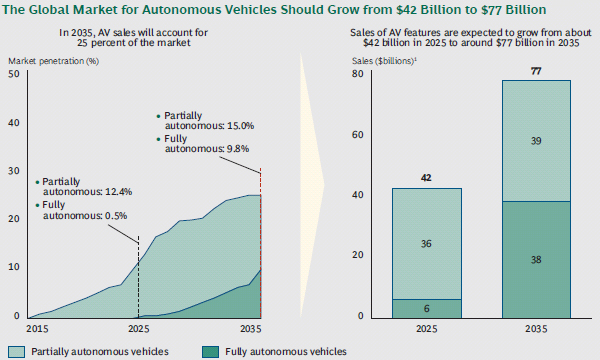

Udział samochodów autonomicznych w całkowitym rynku samochodowym wzrośnie do 13% w 2025 i osiągnie wartość 42 miliardów USD, a w roku 2035 osiągnie wartość 77 miliardów USD i 25% udziału w całym rynku samochodowym. Źródło BCG

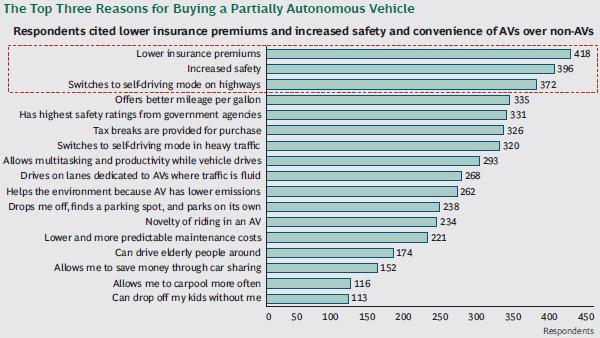

Trzy główne powody dla których klienci podejmują decyzje o kupnie samochodu autonomicznego. Źródło BCG

Algorytmy życia i śmierci

Czas na przykład. Na drodze widzimy samochód prowadzony przez mężczyznę. Obok niego siedzi żona, z tyłu dwójka dzieci. Nagle przed pojazd wybiega dziecko, goniące za piłką. Odległość między dzieckiem i samochodem jest minimalna. Co robi kierowca odruchowo? Albo gwałtownie hamuje, albo gwałtownie skręca… i ląduje na drzewie, ścianie, w rowie, a w najmniej optymistycznym scenariuszu wjeżdża w innych pieszych. A co się dzieje, gdy w takiej samej sytuacji znajduje się pojazd autonomiczny? Wyobraźmy sobie, że jego kierowca zadowolony z tego, że nie musi się niczym przejmować, uciął sobie minutową drzemkę. Samochód musi więc sam wybierać, co robić, kiedy na jezdnię wyskakuje dziecko. Co robi auto? Nie wiemy. Zależy od tego, jak zostało zaprogramowane.

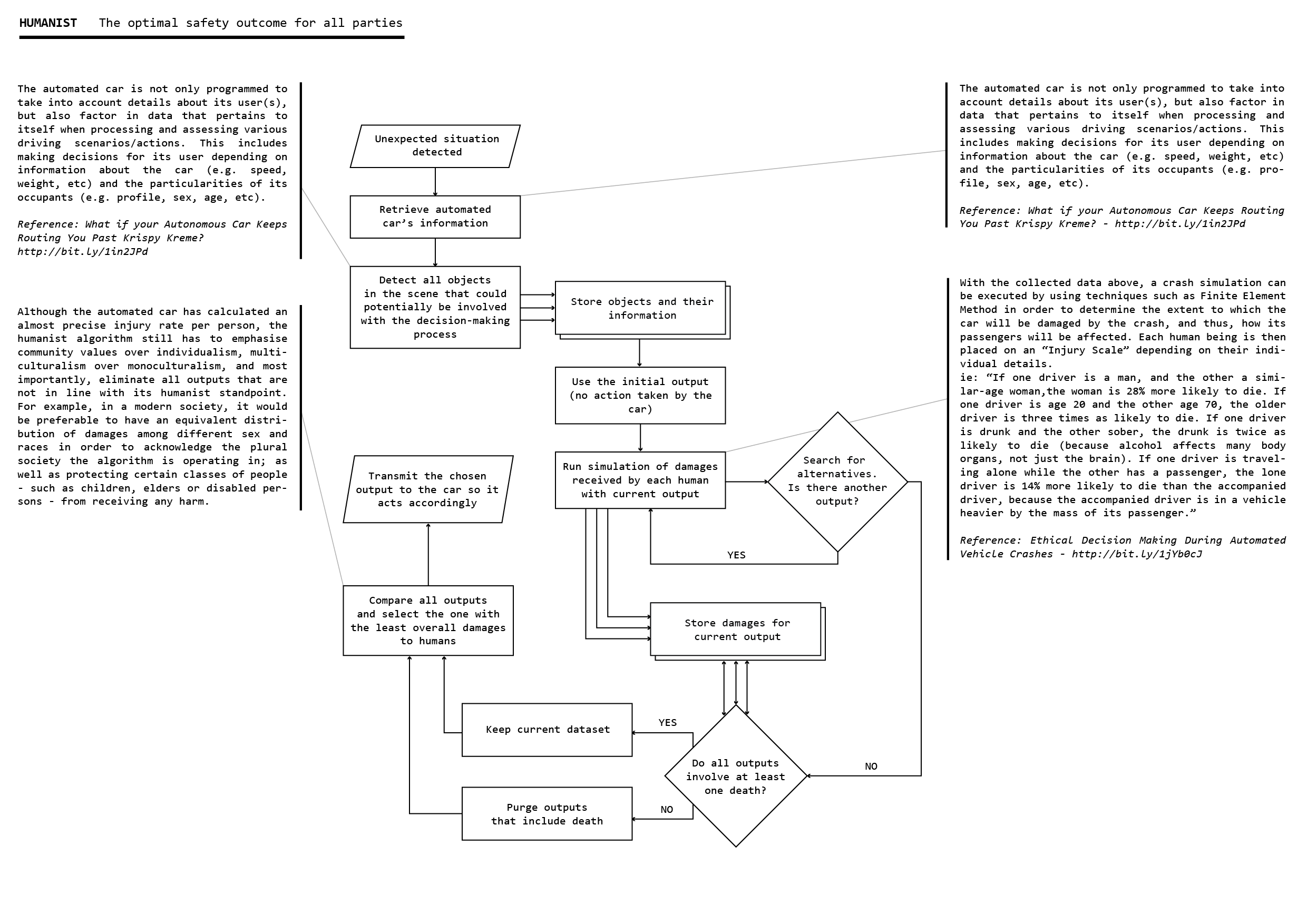

W skrócie, można teoretycznie wybrać trzy drogi w – nazwijmy to – etycznym programowaniu algorytmów, które mogą decydować w dużym stopniu o zachowaniu samochodu.

Pierwsza droga zakłada, że w sytuacji wypadku i zagrożenia życia, liczy się solidarnie dobro wszystkich uczestników wypadku (czyli kierowca, pasażerowie i dziecko na drodze).

W drugim podejściu najważniejsze jest życie pieszych i uczestników ruchu.

W trzecim ujęciu priorytetem jest ochrona życia kierowcy i pasażerów.

Wszystko więc zależy, jaki algorytm będzie w tym przypadku decydujący i który z nich wybierze dana firma.

Niedawno przedstawiciel koncernu Mercedes stwierdził, że w kwestii bezpieczeństwa jego firma stawia na wariant, w którym w pierwszej kolejności zapewnione jest bezpieczeństwo pasażerów pojazdu autonomicznego. No tak, czy jednak takie „programowanie” samochodu byłoby legalne w świetle prawa? Raczej nie. Trudno więc te deklaracje traktować do końca poważnie. Nie zmienia to jednak faktu, że kwestia odpowiedzialności za algorytmy zastosowane w pojazdach jest istotna. I ktoś tą odpowiedzialność będzie musiał ponieść.

Algorytm decyzji systemu sterowania samochodu autonomicznego. Opcja: optymalne wynik dla wszystkich uczestników kolizji. Źródło: MCHRBN.net

Badania, które zabijają popyt?

Ciekawe jednocześnie może być sięgnięcie po opinie potencjalnych nabywców tego typu aut. Badania dotyczące kwestii wypadków i bezpieczeństwa przeprowadzono w kilku krajach. Prestiżowy magazyn Science powołuje się na te, w których wzięło udział nieco ponad 1900 osób. Okazało się, że w odpowiedzi na pytanie, czyje życie jest najważniejsze w sytuacji wypadku – siedzących w samochodzie, czy przechodnia, większość badanych wskazywała tego drugiego. Ale już na pytanie, czy w związku z tym, po pierwsze: badani chcieliby, aby ten pogląd został prawnie usankcjonowany i po drugie: czy gdyby tak się stało, to zdecydowaliby się na zakup pojazdu autonomicznego, odpowiedzi były negatywne w obu przypadkach!

Jeśli te przykłady traktować jako symptomatyczne dla dzisiejszego zamieszania w kwestiach etycznych, to przedstawiciele koncernów nie mogą być do końca zadowoleni.

Dopóki więc potencjalny nabywca nie będzie miał całkowitej pewności, co go czeka w sytuacji, w której samochód autonomiczny spowoduje wypadek, a on będzie siedział za jego kierownicą (teoretycznie całkowicie bezpiecznego), dopóty trudno będzie mówić o tym, że popyt na te produkty ruszy z miejsca. Ludzie nie będą ufali technice, jeśli nie poczują się chronieni przez prawo. Ale czy prawo będzie w stanie przewidzieć wszystkie możliwe warianty i sytuacje?

Deska rozdzielcza samochodu autonomicznego przyszłości – bez kierownicy. Nissan IDS Concept. Źródło: Nissan

Przyszłość jest bezpieczniejsza

Trudno jednocześnie nie odnieść się do kwestii, na ile sama nowoczesna technologia może zwiększać poczucie naszego bezpieczeństwa. Możemy optymistycznie patrzeć w przyszłość i wyobrazić sobie moment, w którym na drogach poruszają się prawie wyłącznie pojazdy autonomiczne. Ich wewnętrzne systemy elektroniczne na drodze na bieżąco będą się ze sobą komunikowały i generowały dzięki temu odpowiednie zachowania pojazdu, również w stosunku do innych uczestników ruchu. O bezpieczeństwo jazdy będą dbać zamontowane w samochodzie czujniki ruchu i radary, dzięki którym prędkość pojazdu będzie dostosowana do otoczenia oraz innych samochodów.

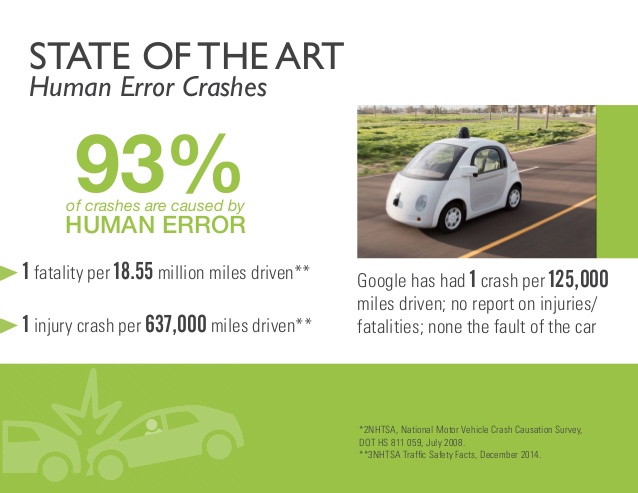

Producenci pojazdów autonomicznych już dzisiaj chętnie powołują się na badania, z których wynika, że pojazdy autonomiczne znacznie zredukują liczbę wypadków. Przykładowo, według analityków firmy konsultingowej KPMG w samej tylko Wielkiej Brytanii dzięki samochodom autonomicznym do 2030 na drogach zginie o ok. 2,5 tys. osób mniej. Niestety, ciągle mówimy o sytuacji laboratoryjnej, teoretycznej. Bo wiemy, że przez jeszcze długi czas na drogach będą dominować kierowcy w zwykłych pojazdach pozbawionych elektronicznego pilota.

95% ze wszystkich wypadków drogowych powodowanych jest przez błąd człowieka. Źródło: Google

Czas na zmiany

Podsumowując, osobiście wierzę w to, że technologia przyniesie nam wszystkim więcej korzyści. Jednak konieczność uregulowań prawnych i kwestie etyczne nie znikną nigdy. Na razie, na szeroką skalę takie uregulowania nie powstały. Biorąc pod uwagę, że nowe technologie lubią nas zaskakiwać szybkością z jaką się rozwijają i zmieniają rzeczywistość, nie jestem pewien, czy na dalsze odwlekanie pewnych decyzji możemy sobie pozwolić.

Powiązane artykuły:

– Machine Learning. Komputery nie są już niemowlętami

– Sztuczna Inteligencja jako fundament dla kluczowych technologii

– Sztuczna Inteligencja dostępna i pomocna dla każdego z nas

– Koniec życia jakie znamy, czyli witajcie w zdygitalizowanym świecie

– Mózg, urządzenie które wypada z obiegu

– TESLA a ludzkie prawo do błędów

Jacek Czyz

Rewolucja przemysłowa doprowadziła do utraty pracy przez wiele tysięcy tkaczy, szwaczek i rzemieślników. Efektem był ruch luddystów, którzy walczyli z industrializacją przez niszczenie maszyn. Owszem, do obsługi nowych maszyn będzie potrzeba wielu specjalistów, ale uzyskanie kwalifikacji przez specjalistę kosztuje tym więcej czasu i pieniędzy im większe kwalifikacje posiada. Czy wielu z przykładowych kelnerów zastąpionych przez roboty zdoła zostać serwisantami tych robotów? W okresie przejściowym nie będzie tak łatwo. Pokazały to wydarzenia w latach dwudziestych dziewiętnastego wieku, gdy wielu luddystów straciło życie za niszczenie maszyn.

Norbert Biedrzycki

Automation and AI will lift productivity and economic growth, but millions of people worldwide may need to switch occupations or upgrade skills – see technology professionals such as computer engineers and specialists

Jacek Czyz

Bardzo trudno jest porzucić kontrolę nad maszyną. Przyzwyczailiśmy się do myślenia, że skoro algorytmy są logiczne, komputery wygrywają w grach logicznych (takich jak szachy czy GO), to cała populacja robotów czy aplikacji będzie zachowywać się logicznie i przewidywalnie. Ale komputery nigdy nas nie zastąpią nas w czynnościach, których sami jako ludzie nie potrafimy sprowadzić do logicznych ciągów komend.

Jacek B2

Coraz więcej firm bierze na siebie odpowiedzialność za błądy popełniane przez samodzielne automaty. Ostatnio volvo i mercedes. Poprzednio Siemens automation. Ale nie ma poprawnych rozwiązań prawnych. A co z ubezpieczeniem? Kto za nie zapłaci? A co w przypadku shared economy? To tematy na inną dyskusję

Grzegorz Wiatr

To jest problemtyka od której potencjalnie będzie zależeć istnienie naszego gatunku na Ziemi. Czy algorytmy są ważniejsze niż życie? I kto będzie odpowiadał za fałszywe działanie algorytmów? Programista? Bo przecież wiemy że oprogramowanie zawsze ma błędy. Tyle tylko że jeszcze nie odkryte

Norbert Biedrzycki

Panie Grzegorzu. Dotyka Pan senda problemu. Kto będzie odpowiedzialny za błędy maszyn i kto będzie odpowiedzialny za maszyny projektowane i produkowane przez maszyny. Problem etyczny i prawny

TomaszK1

Nie rozróżniają i długo jeszcze samodzielnie nie będą mogły rozróżniać. Do tego potrzeba emocji a tego nie da sie zaprogramować

Andrzej K

Bardzo ciekawe. Ale znowu będę tu pesymistą. Pan jest entuzjastą i optymistą. W przeciwieństwie do mnie. Nie wierzę w wolną wolę i etykę maszyn. Na koniec to ludzie programują i opisują zachowania maszyn, stawiając im bariery. Czyli maszyny są nie jako kalkami zachowań ludzi. Jeśli my jesteśmy źli to jak maszyny mają być dobre? Dla nas?

Norbert Biedrzycki

Tu niestety muszę się zgodzić że w negatywnym scenariuszu to maszyny przejmą wzorce od ludzi. Nawet negatywne. Pomyślmy jaki wpływ na nie może mieć zawód „nayczyciela AI” – to co ostatnio powstaje w US (Google, Amazon …)

Andrzej44

A Volvo wchodzi w 2019 w elektryczne samochody i porzuca silniki spalinowe https://futurism.com/volvo-becomes-the-first-premium-car-maker-to-go-all-electric/

DCzaj

W podanym linku do testu o decyzjach jest bardzo wiele ciekawych przypadków, na przykład to, jak zmieniają się nasze opinie, gdy dotyczą autonomicznego pojazdu, w którym jest z naszej rodziny. Wtedy jesteśmy mniej skłonni poświęcić życie pasażerów samochodu. Gdy rozważane są ogólne zasady, jakim takie pojazdy miałyby podlegać, jesteśmy skłonni zaakceptować regułę mniejszej liczby ofiar. Gdy jednak rozważany jest konkretny przypadek, a w aucie mamy znajdować się my sami albo ktoś z rodziny – autonomiczne samochody sterowane takimi szczytnymi algorytmami przestają być atrakcyjne, by my jaki ludzie wybrali bysmy życie naszej rodziny i swoje własne. Takie czysto teoretyczne przykłady

Jacek Krasko

Bardzo ciekawy link. Polecam ! Moje wyniki mocno zaskoczyły mnie samego. Niestety 🙁

Krzysztof C

Sprobujcie tego http://moralmachine.mit.edu. Bardzo ciekawe ćwiczenie jak każdy z nas by zreagował i jaką podjął decyzję – wszystko moralnie niejednoznaczne

CabbH

W mojej oecnie to tylko kwestia czasu kiedy maszyny zostaną wyposażone w emocje http://www.ai.mit.edu/projects/sociable/emotions.html . Co nie znaczy że będą je odczuwać. Nie będą emocjonalne. Będą działały wg. algorytmu udającego emocje. A to zupełnie co innego

Krzysztof Bikowski

… a same samochody autonomiczne. Zdecydowanie poprawią bezpieczeństwo na drodze – ale tylko pod warunkiem ze wyeliminujemy wszystkich kierowcow. Oni są głównym powodem wypadków drogowych

Krzysztof Bikowski

Bardzo mocon wątpię czy kiedykolwiek będzie można „zaprogramować” emocje. To jest tak jak nasze emocje, odczucia są „wczytywane” do maszego mózgu przez całe życie. Jest to uwarunkowane genami, wychowaniem, otoczeniem, stanem majątkowym, porażkami, sukcesami …. tego nie da się zaprogramować

JacekPaczka

Niestety alebo na szczęście dobro i zło można zaprogramować. Np tworząc odpowiednie wzorce do naśladowania. Człowiek uczy się odróżniać dobro od zła metodą obserwacji i tworzenia wzorców postępowania. Potem jest to wzmacniane lub korygowane przez otrzymywany przekaz informacji mówionej – tzw. pętla zwrotna. Samo zaprogramowanie można stworzyć podobnie. W pamięci trwałej jako dogmat. Tylko ilość pamięci na tworzenie nowych wzorców musiałaby być ograniczona. Po to, żeby nie powstał na bazie tworzonego dobrego wzorca, wzorzec zły. To niezależnie od tego, że pamięć neuronowa powinna być samokontrolująca się np. z zestawu sześciu zapisanych pamięci wzorca dawać identyczny wzorzec na wyjściu. Można to osiągnąć metodą sumowania bitów do określonego poziomu.

Adam T

To jest duży problem ale w mojej ocenie problem w tym przypadku leży po stronie ludzi. Powinniśmy całkowicie rozdzielić ruch pieszy, rowerowy, drogowy i szynowy – wszędzie. Piesi uważają tylko na innych pieszych, rowerzyści na rowerzystów, samochody na samochody. Ale w związku z tym by przebudować właściwie na nowo wszystkie miasta, miasteczka, wsie i skrzyżowania na w pełni bezkolizyjne. Ale za to wtedy autonomiczne pojazdy mogą lepiej kontrolować sytuacje na drodze, komunikując się z innymi pojazdami przed i za nimi np czy dając znać dużo wcześniej że będzie skręcał na najbliższym skrzyżowaniu. Ilu jest kierowców co nie włącza kierunkowskazu? Automat powiadomi najbliższe automaty i odbierze potwierdzenie że zamiar skrętu został przez nie odebrany, zaakceptowany i dostosują się do jego manewru.