Technologia staje się dla nas coraz bardziej „przeźroczysta”. Nie ma nic zwyklejszego, niż nasz osobisty komputer, który liczy, umożliwia odczyt najróżniejszych plików, łączy nas z internetem. Ale czy może jeszcze nas czymś zaskoczyć? Taką szansę może stworzyć Cognitive Computing – zespół umiejętności traktowanych często, jako najpoważniejszy przejaw sztucznej inteligencji.

Na studiach oraz na początku mojej kariery zawodowej zajmowałem się pisaniem oprogramowania. Pierwsze pieniądze zarobiłem jako programista. Siedziałem wieczorami, zarywałem noce i poprawiałem niekończące się błędy w moim kodzie. Były też momenty kiedy napisany kod zaczynał działać tak, jak chciałem, dokładnie w taki sposób, do jakiego został stworzony. Z czasem takich momentów zaczynało być coraz więcej. Niejednokrotnie zastanawiałem się, czy praca programisty może zostać zastąpiona? Jak i czym? Czytając fantastykę naukową ciągle napotykałem na roboty, sztuczne inteligencje, technologie, które same się uczyły, wykraczały poza nadane ramy, zasady, procedury, algorytmy. Technologie, które były w stanie uczyć się na własnych doświadczeniach i błędach. Wtedy była to fantastyka. Program komputerowy wychodzący poza zadane przez programistę ramy działania? Mrzonka. A potem zacząłem stykać się nowymi pojęciami, jak samouczące się maszyny, czy sieci neuronowe.

Okazało się, że program komputerowy może mieć doświadczenia, których sam nabywa, na postawie których zmienia swoje działanie i w efekcie uczy się w oparciu o te samodzielnie zdobyte lub wczytane doświadczenia. Dowiedziałem się o algorytmach, które próbując działać podobnie, jak ludzki mózg – same się zmieniają i modyfikują, próbując znaleźć najbardziej optymalne rozwiązanie danego problemu. Poznałem pojęcie Cognitive Computing i właśnie przemyśleniami na ten temat chciałbym się podzielić w poniższym tekście.

Jako że wszystkie polskie tłumaczenia terminu Cognitive Computing są albo mało trafne, albo zbyt wieloznaczne, będę używał formy angielskiej, do której także międzynarodowe środowisko technologiczne zdążyło się już przyzwyczaić.

Komputer licząc, przygląda się twojej twarzy

Wszystkie funkcjonujące definicje Cognitive Computing zawierają w sobie kilka wspólnych, powtarzających się elementów. Najogólniej rzecz ujmując, termin ten oznacza zespół technologii, które w dużej mierze są efektem studiów nad działaniem ludzkiego mózgu. Jest to swoiste połączenie Sztucznej Inteligencji i Przetwarzania Sygnałów – dwóch elementów kluczowych dla rozwoju świadomości maszyn technologii. Łączą one w sobie zestaw nowoczesnych narzędzi: samo-uczenie się maszyn, rozumowanie i wnioskowanie, przetwarzanie języka naturalnego, mowę, interakcje komputer-człowiek i wiele innych. Wszystkie są aspektami współpracy między maszynami i człowiekiem. Krótko mówiąc, termin Cognitive Computing odnosi się do technologii, które naśladują sposób przetwarzania informacji w ludzkim mózgu oraz zwiększają jakość procesu podejmowania decyzji przez człowieka.

Cognitive computing. Co oznacza to pojęcie i do czego może nam się ta technologia przydać

Cognitive Computing stanowi niejako komputerową symulację procesów myślowych człowieka. Konstrukcja taka generuje szereg nowych możliwości dla urządzeń, które ją wykorzystują oraz samego użytkownika. Maszyny zbudowane w oparciu o ideę Cognitive Computing są już w stanie aktywnie rozumieć języki naturalne i reagować na zdobywane w ten sposób informacje, potrafią też rozpoznawać obiekty, łącznie z ludzkimi twarzami. Stają się w ten sposób produktem ludzkiego umysłu, który nie ma sobie równych na przestrzeni całej historii.

Czas na przekąskę, Norbert

Analizując Cognitive Computing mówimy w istocie o zespole cech i właściwości, które powodują, że maszyna staje się coraz bardziej inteligentna, a tym samym coraz bardziej nam przyjazna. Cognitive Computing można traktować jako nową technologiczną jakość, bowiem między człowiekiem i obsługiwaną przez niego maszyną, rodzi się nowe, subtelne połączenie. Jeszcze nie emocjonalne i duchowe, ale będące czymś więcej, niż tylko relacją podmiot – przedmiot.

To właśnie dzięki tej jakości, komputerowi asystenci tacy jak chociażby Siri (producent Apple), będą stopniowo nabierać ludzkich cech. Dążenie do rozwoju tych cech może wynikać z faktu, że dla ludzi zaangażowanych w tworzenie technik komputerowych największym wyzwaniem jest doprowadzenie do tego, by maszyna jak najdokładniej rozumiała użytkownika. Nie tylko jego pytania, ale i intencje. By potrafiła „odczytywać” znaczące, dodatkowe sygnały, które są jej wysyłane przez użytkownika w trakcie pracy nad danym zagadnieniem. Jeszcze inaczej: by uwzględniała pojęciowy i społeczny kontekst jego działań. Przykład? Na proste pytanie o godzinę, skierowane do komputerowego asystenta, być może otrzymam wkrótce konkretną odpowiedź, ale wzbogaconą o dodatkowe, pełne empatii sformułowanie: „13.30. Może czas na przerwę i przekąskę? Norbert, jak sądzisz?”

Jak działa Siri. Źródło: HowTechnologyWork

Droga maszyno, proszę o konkretne wskazówki

Tu chciałbym na chwilę się zatrzymać i odesłać czytelnika do mojego poprzedniego tekstu o Machine Learning. Pisałem w nim, że technologia ta pozwala komputerom uczyć się, a tym samym przeprowadzać analizy danych z coraz większą skutecznością, która ma związek z całym dotychczasowym „doświadczeniem” maszyny zdobywanym w trakcie wykonywania wcześniej podobnych operacji. Przykładowo: wielokrotnie już wspominany przeze mnie komputer IBM Watson rozumie pytania zadawane mu w języku naturalnym. Chcąc na nie odpowiedzieć, przeszukuje potężne zbiory danych o różnym charakterze – dotyczą one zagadnień biznesowych, matematycznych czy medycznych. Wraz z kolejnymi zadaniami (pytaniami), doskonali on swoje umiejętności. Im więcej danych zaabsorbuje, im więcej zadań dostaje do rozwiązania, tym bardziej jego umiejętności analityczno-poznawcze rosną.

Machine Learning jest już zaawansowaną, ale ciągle podstawową zdolnością maszyny, która pozwala nam mówić o pewnych podobieństwach do ludzkiego mózgu. Jest to swoiste samodoskonalenie przez doświadczenie. Jednak dopiero Cognitive Computing jest tą technologiczną możliwością, która gwarantuje użytkownikowi głębszą satysfakcję z obcowania z – praktycznie – inteligentnym urządzeniem. Dostarcza ono już nie tylko uporządkowanych informacji, nie tylko tworzy samodzielnie algorytmy, ale sugeruje użytkownikowi, jaką drogę do rozwiązania danego problemu obrać. Lekarz korzystający z komputera IBM Watson, może więc liczyć na to, że komputer nie tylko przeanalizuje miliardy informacji (Big Data) i wyciągnie wnioski, ale równię zasugeruje lekarzowi sposób rozwiązania nurtującego go problemu.

Posłużę się tu dodatkowo przykładem znanym z naszego codziennego doświadczenia. Nawigacja samochodowa opiera się na analizie tysięcy danych topograficznych, dzięki czemu wygenerowana zostaje mapa, którą możemy zobaczyć na ekranie oraz trasa przejazdu z zadanego punktu A do punktu B, uwzględniająca nasze nawyki w podróży i poprzednie trasy (Machine Learning). Natomiast fakt, że nasz pokładowy komputer sugeruje nam określoną drogę, w celu uniknięcia korków, ciągle uwzględniając nasze nawyki, to już jest prawie działanie z obszaru Cognitive Computing.

Zrozumieliśmy, że liczenie to nie wszystko

No dobrze, ale jak współczesna technologia doszła do idei, by komputer zaczął zajmować się czymś więcej, niż tylko szybkim liczeniem? Jeffrey Welser, dyrektor Almaden Research Center w IBM, czyli koncernie, który od blisko 50 lat pracuje nad zagadnieniem maszynowej inteligencji, udzielił na to pytanie prostej odpowiedzi: „Ludzki umysł czasem nie radzi sobie dobrze z liczbami, natomiast sprawdza się doskonale w innych dziedzinach, na przykład w zabawie, strategiach, w rozumieniu języka naturalnego, rozpoznawaniu twarzy. No więc chcieliśmy, aby komputery też sprawdzały się i na tych polach”.

Starania, aby wykorzystać algorytmy i Machine Learning do stworzenia maszyny, która będzie umiała pomagać człowiekowi w podejmowaniu decyzji, doprowadziły do spektakularnego efektu. Koncern IBM, konstruując Watsona, wyznaczył dla świata technologicznego zupełnie nowe standardy.

I jak to teraz wykorzystać?

Studiowanie ludzkiego mózgu, które doprowadziło do rozwoju technologii informatycznych, przyniesie z pewnością dalsze konsekwencje dla różnych obszarów naszego życia: biznesu, bezpieczeństwa, marketingu, nauki, medycyny, przemysłu. Rozumiejące języki i rozpoznające obiekty, „patrzące” komputery mogą pomagać wszystkim: od szeregowego nauczyciela prowadzącego lekcję począwszy, na naukowcu szukającym lekarstwa na raka skończywszy. W biznesie, omawiana technologia, powinna stać się z czasem użytecznym narzędziem, które umożliwi efektywne wykorzystanie zasobów ludzkich, lepsze nabywanie nowych kompetencji i w efekcie poluzuje sztywne korporacyjne reguły oparte na tradycyjnych modelach zarządzania. Jeśli chodzi o medycynę, sporo już napisano o nadziejach, jakie wiążą lekarze z pojawieniem się na scenie doskonałego narzędzia analitycznego, jakim jest IBM Watson. Stosowany do opieki lekarskiej pozwoli na precyzyjne śledzenie historii choroby, wspomoże diagnostykę, umożliwi błyskawiczne dotarcie do informacji, które dla lekarza trudne do zdobycia w oczekiwanym czasie. Może doprowadzić do jakościowej zmiany w diagnozowaniu i leczeniu chorób, które dzisiaj wydają się nieuleczalne.

Komputer ten cieszy się szczególnym zainteresowaniem w środowiskach związanych z onkologią, bowiem w zmaganiu się z rakiem pozwala na błyskawiczne przeszukiwanie gigantycznych baz danych dotyczących tego zagadnienia i dostarczanie lekarzom istotnych podpowiedzi.

W połączeniu z komputerami kwantowymi będzie stanowił bardzo silne narzędzie do rozwiązywania skomplikowanych problemów technologicznych. Marketingowcy już dzisiaj doceniają pracę systemów opartych na Congitive Computing, które zaczynają odgrywać poważną rolę w procesach automatyzacji, w kontakcie z klientem, z dobieraniem dla niego zindywidualizowanej oferty. Każdy obszar ludzkiej aktywności, w którym istotną rolę odgrywa przetwarzanie danych, strategiczne planowanie i modelowanie będzie prędzej czy później beneficjentem przełomu technologicznego, o którym piszę.

Trzecia era maszyn

Niektórzy twierdzą wręcz, że dzięki Cognitive Computing wkraczamy w trzecią erę informatyki. Na początku ubiegłego wieku mówiło się o komputerach, że są maszynami liczącymi. Potem, począwszy od lat 50. stały się już urządzeniami działającymi w oparciu ogromne bazy danych. W XXI wieku zmieniły się w urządzenia widzące, słyszące i myślące. A że myślenie ludzkie jest procesem złożonym i prowadzi czasem do działań nieprzewidywalnych, może już teraz należy założyć, że poznawczej (ang. Cognitive) bliskości człowieka i maszyny będą towarzyszyć wydarzenia trudne jeszcze do przewidzenia.

Maszyny przyszłości muszą zmienić sposób w jaki ludzie zdobywają czy pogłębiają swoją wiedzę, a w konsekwencji mogą doprowadzić do „poznawczego” przyśpieszenia. Ale i bez względu na przyszłość, teraźniejszość, w której obecne są coraz sprawniej myślące komputery, staje się coraz ciekawsza.

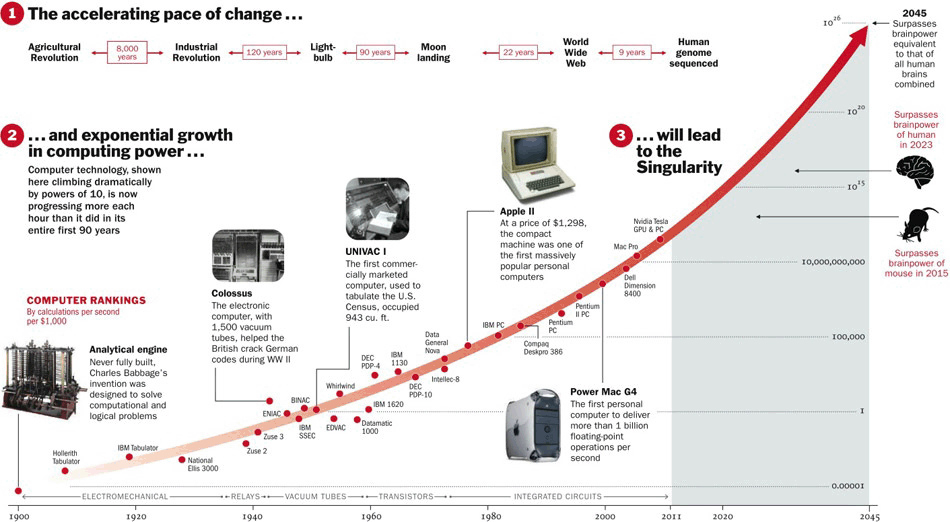

Wykładniczy wzrost możliwości technologii doprowadzi do powstania technologicznej osobliwości (ang: singularity). Źródło: Sneaky Magazine

Powiązane artykuły:

– Tylko Bóg potrafi policzyć równie szybko, czyli świat komputerów kwantowych

– Machine Learning. Komputery nie są już niemowlętami

– Niewidzialna pajęczyna wokół nas, czyli Internet Rzeczy

– Według naszych komputerów … Pan nie istnieje

– Trwałe połączenie technologii z człowieczeństwem

– Mózg, urządzenie które wypada z obiegu

– W jaki sposób maszyny rozumują

Zwierzak

Dzięki splątaniu kubitów komputer kwantowy może wykonywać obliczenia na wszystkich wartościach jednocześnie, w przeciwieństwie do tradycyjnego komputera, który realizuje operacje w określonej kolejności – jedna za drugą.

CzarekZ23

Wiadomo też powszechnie, że Chiny, które chcą być liderem, jeśli chodzi o technologie sztucznej inteligencji, intensywnie pracują nad dronami (ze szczególnym uwzględnieniem dronów, które operowałyby grupowo, w tzw. rojach) zdolnymi do przenoszenia pocisków samosterujących i samodzielnie wyszukujących cele.

CabbH

Raymond Kurzweil, genialny futurysta ale też jedna z najbardziej prominentnych osób w Google LLC w 2005 pisał o możliwości stworzenia świadomego cyfrowego bytu. O ile jeszcze 10 lat temu, jego idee z ksiąski How to Create a Mind, traktowano jako czystą futurystkę, dzisiaj stają się praktycznymi pytaniami jak widać z tego artykułu.

Jacek Czyz

Często myślimy, że skoro algorytmy są logiczne, komputery wygrywają w grach logicznych, to cała populacja robotów czy aplikacji będzie zachowywać się logicznie i przewidywalnie. Duży błąd, bo komputery wcale nie muszą być logiczne. Nie zastąpią nas w czynnościach, których sami jako ludzie nie potrafimy sprowadzić do logicznych zdarzeń. Być może czeka nas kubeł zimnej wody

Robert Kaczkowski

nie chcę żeby maszyna mnie przytulała – chcę żeby dla mnie pracowała i wykonywała moje rozkazy

Grzegorz Wiatr

A może pewnego dnia maszyny dojdą do wniosku że największym zagrożeniem dla ekosystemu jesteśmy my, ludzie? I po prostu nas wyeliminują. To byłby chichot historii

Norbert Biedrzycki

Zależy od tego jak je nauczymy i jakie zadanie przed nimi postawimy. Ciekawe jak mogą zareagować na zadanie „Zapewnij ochronę ekosystemu naszej planety”. Co wtedy zrobią z nami – największym szkodnikiem historii 🙂

Andrzej_Ko

Tytuł prowokujący. Nie doradzi … a przeprowadzi analizę i wyciągnie wnioski. Pozdrawiam

TomaszK1

Bardzo ciekawy artykuł , Jak Pan mysli kiedy sztuczna inteligencja wyrwei się spod naszej kontroli?

Norbert Biedrzycki

Skracając ok 2050 roku powstanie superinteligencja, swoiste zjednoczenie ludzi i maszyn. Nie wiem czy AI się wyrwie na wolność, raczej osiągnie samoświadomość. Następne kroki mogą być ciekawe

Andrzej44

A co w sytuacji kiedy maszyny staną się inteligentniejsze od ludzi? Jaka rola nam wtedy przypadnie? Czy skończymy jak bateria w Matrixie? Ja dożyję 20145 roku, kiedy to ma powstać superinteligencja – jak szacuje Kurzweil – to zobaczę. Strach o przyszłe pokolenia

Norbert Biedrzycki

Proszę przeczytać jego książkę z przed 15 lat: Singularity… Jedyna droga to swoista integracja człowieka z maszyną

DCzaj

A Kurzweil pisze o człowieku 2.0. Czyli połaczeniu biologicznego człowieka z maszynami. Ma to być cyborg-hybryda, człowiek sztucznie wzmocnioniy, rozszerzony o technologie wspomagające jego zycie, poszerzające zmysly i wzmacniające życie, siłe, odporność …

Jacek Krasko

Podstawowym sprawdzianem inteligencji kognitywistycznej jest skuteczność podejmowania decyzji w sytuacjach „życiowych”. Jak tu się sprawdzi maszyna? Pewnie w oparciu o dane i statystykę i algorytmy. Ale czy bedzie w takich sytuacjach „prawdziwa”? Test Turinga? Służy również do różnych form współpracy między człowiekiem i komputerem/robotem

Krzysztof C

Czyli tak naprawdę to wszystkie obszary technologi któ®e składają się na AI:

http://whatis.techtarget.com/definition/cognitive-computing

„Cognitive computing is the simulation of human thought processes in a computerized model. Cognitive computing involves self-learning systems that use data mining, pattern recognition and natural language processing to mimic the way the human brain works. The goal of cognitive computing is to create automated IT systems that are capable of solving problems without requiring human assistance.”

Krzysztof C

Cognitive computing – bardzo trudna koncepcja oparta na powichrowanych zasadach matematycznych. Czy dzięki temu komputery, sztuczne inteligencje, maszyny staną się bardziej ludzkie? Mocno wątpie. Zresztą nie jest to chyba nasz cel

CabbH

Nie wiem czy mój poprzedni komentarz został dodany pod tym artykułem. Postaram się go powtórzyć. Pisałem że wreszczie w prosty sposób Pan wyjasnił takie trudne pojęcie jak cognitive computing. Czy gdzieś można posłuchać Pana wykładów? Bardzo by mi zależało na posłuchania Pana na zywo i zadania kilku pytań nt człowieczeństwa vs AI, czy naszej roli w przyszłości. Poproszę o informacje na maila

CabbH

Kurcze. Wreszcie zrozumiałem co to znaczy congintive computing. Bardzo dziękuje. Super przystępnie napisany artykuł. Czy jest Pan wykładowcą? Gdzieś można posłuchać Pańskich wykładów? Niesamowicie szeroki zakres tematyczny Pan porusza i zarazem bardzo fajnie opisuje Pan współczesnego człowieka w tym wszystkim. Bardzo dziękuje 🙂